Anthropic acusa a DeepSeek, Moonshot y MiniMax de robar capacidades de Claude con 16 millones de consultas fraudulentas

por Edgar OteroAnthropic ha publicado un extenso informe en el que acusa a tres laboratorios de inteligencia artificial chinos, concretamente, DeepSeek, Moonshot AI y MiniMax, de llevar a cabo operaciones masivas para clonar las capacidades de Claude. Según la compañía, estos laboratorios habrían creado aproximadamente 24.000 cuentas fraudulentas que generaron más de 16 millones de intercambios con Claude, violando sus términos de servicio y las restricciones de acceso regional.

La técnica utilizada se conoce como destilación, un método ampliamente empleado en la industria de IA pero que Anthropic considera ilícito cuando se usa para extraer capacidades de modelos competidores sin autorización. Los números son impresionantes: DeepSeek habría generado más de 150.000 intercambios, Moonshot AI superó los 3,4 millones y MiniMax lideró la operación con más de 13 millones de consultas.

Anthropic afirma tener "alta confianza" en la atribución de cada campaña a laboratorios específicos mediante correlación de direcciones IP, metadatos de solicitudes, indicadores de infraestructura y, en algunos casos, corroboración con socios de la industria que observaron los mismos actores en sus plataformas. Cada campaña habría apuntado específicamente a las capacidades más diferenciadas de Claude: razonamiento agéntico, uso de herramientas y programación.

Qué es la destilación de modelos y por qué es importante

La destilación es una técnica de aprendizaje automático que permite entrenar un modelo estudiante utilizando las respuestas de un modelo maestro más avanzado. El proceso consiste en alimentar al modelo original con miles de consultas cuidadosamente diseñadas, recopilar todas las respuestas y utilizar esos pares de entrada-salida para entrenar un modelo más pequeño y económico.

El método es legítimo cuando se aplica internamente. Los grandes laboratorios de IA lo usan rutinariamente para crear versiones más pequeñas y baratas de sus propios modelos para clientes. OpenAI, por ejemplo, creó GPT-4o Mini como una destilación de GPT-4o. El problema surge cuando competidores lo utilizan para adquirir capacidades potentes de otros laboratorios en una fracción del tiempo y coste que llevaría desarrollarlas independientemente.

Según Anthropic, los modelos destilados ilícitamente carecen de las salvaguardas necesarias, creando riesgos significativos de seguridad nacional. La compañía argumenta que Claude está construido con sistemas que impiden que actores estatales y no estatales usen IA para desarrollar bioarmas o realizar actividades cibernéticas maliciosas. Los modelos construidos mediante destilación ilícita probablemente no conserven esas protecciones, permitiendo que capacidades peligrosas proliferen sin controles.

Cómo DeepSeek habría extraído las capacidades de Claude

Según el informe, DeepSeek empleó una técnica particularmente sofisticada: sus prompts pedían a Claude que imaginara y articulara el razonamiento interno detrás de una respuesta completada y lo escribiera paso a paso, generando efectivamente datos de entrenamiento de cadena de pensamiento a escala masiva. También se observaron tareas en las que Claude se usaba para generar alternativas seguras ante la censura para consultas políticamente sensibles sobre disidentes, líderes del partido o autoritarismo.

La operación generó tráfico sincronizado entre cuentas con patrones idénticos, métodos de pago compartidos y tiempos coordinados, sugiriendo un balanceo de carga para aumentar el rendimiento, mejorar la fiabilidad y evadir la detección. Anthropic afirma haber rastreado estas cuentas hasta investigadores específicos del laboratorio mediante metadatos de solicitudes.

Para eludir las restricciones, estos laboratorios habrían utilizado servicios proxy comerciales que revenden acceso a Claude y otros modelos de IA a gran escala. Estos servicios operan arquitecturas de clúster hidra, es decir, redes extensas de cuentas fraudulentas que distribuyen tráfico a través de la API y plataformas en la nube de terceros. La amplitud de estas redes significa que no hay puntos únicos de fallo. Cuando se prohíbe una cuenta, otra toma su lugar. En un caso, una sola red proxy gestionó más de 20.000 cuentas fraudulentas simultáneamente.

El caso de MiniMax es especialmente revelador. Anthropic detectó la campaña mientras aún estaba activa, antes de que MiniMax lanzara el modelo que estaba entrenando, proporcionando visibilidad sin precedentes sobre el ciclo de vida completo de los ataques de destilación. Cuando Anthropic lanzó un nuevo modelo durante la campaña activa de MiniMax, este pivotó en 24 horas, redirigiendo casi la mitad de su tráfico para capturar capacidades del último sistema.

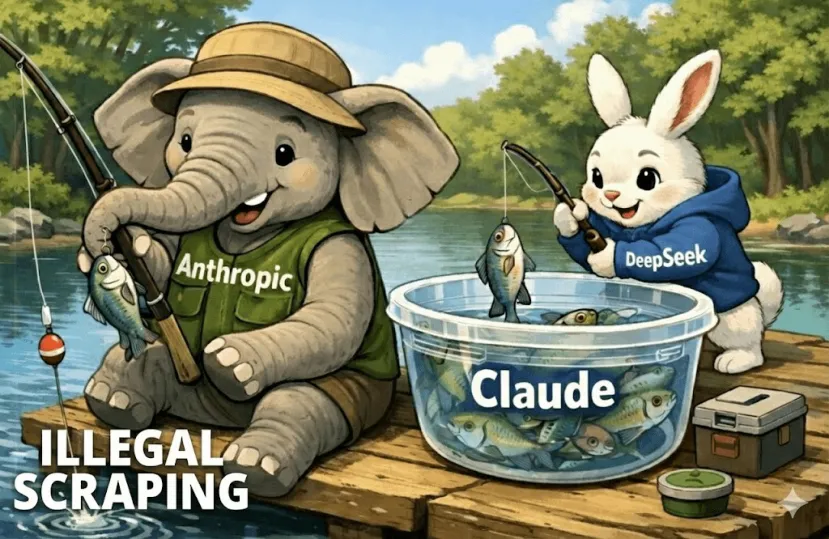

La ironía del scraping: Claude tampoco se construyó con datos legítimos

Las acusaciones de Anthropic plantean una contradicción incómoda en la industria de la IA. La compañía denuncia con vehemencia que otros laboratorios extraigan ilegítimamente las capacidades de Claude, pero Claude mismo fue entrenado con materiales extraídos de Internet sin permiso expreso de los creadores de contenido.

La situación crea un escenario paradójico: Anthropic acusa a otros de "pescar ilegalmente" en sus aguas, mientras que esas mismas aguas se llenaron originalmente mediante prácticas cuestionables. La diferencia, según la compañía, es que la destilación de modelos competidores viola términos de servicio específicos y elimina salvaguardas de seguridad, mientras que el scraping de Internet para entrenamiento inicial es una práctica extendida en la industria que aún no ha sido condenada de forma definitiva por los tribunales.

Anthropic ha implementado múltiples defensas contra estos ataques, incluyendo clasificadores y sistemas de huella digital conductual diseñados para identificar patrones de ataque de destilación en el tráfico de API. La compañía también está compartiendo indicadores técnicos con otros laboratorios de IA, proveedores de nube y autoridades relevantes, reconociendo que ninguna empresa puede resolver esto sola y que se requiere una respuesta coordinada de toda la industria.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!